Bem Vindo ao

SPARKANOS

Bem-vindo ao curso "Sparkanos", onde a força, a disciplina e a estratégia dos antigos espartanos são trazidas para o mundo do Big Data. Inspirado pelos guerreiros que se preparavam incansavelmente para grandes batalhas, este curso foi criado para equipar você com as habilidades necessárias para enfrentar e vencer os desafios do mercado de dados atual.

Neste treinamento intensivo, você aprenderá a dominar Apache Spark, MiniO, Trino, Apache Superset, Airflow e Open Metadata, integrando essas ferramentas para criar um lakehouse com quatro camadas robustas: landing zone, bronze, silver e gold. Prepare-se para uma jornada que transformará seus dados em informações valiosas e acionáveis, com a precisão e eficiência dos lendários guerreiros.

- Capacitar os participantes a construir e gerenciar um lakehouse completo.

- Ensinar técnicas avançadas de processamento e análise de dados com Apache Spark.

- Implementar um sistema de armazenamento de dados eficiente com MiniO.

- Executar consultas distribuídas de alto desempenho com Trino.

- Desenvolver visualizações e dashboards interativos com Apache Superset.

- Orquestrar fluxos de trabalho e automação de tarefas com Apache Airflow.

- Gerenciar e governar dados eficientemente com Open Metadata.

E o melhor tudo isso num Docker, uma vez desenvolvido todo o projeto do Treinamento você poderá replicar essa arquitetura na sua empresa e gerar ainda mais valor nos teus projetos.

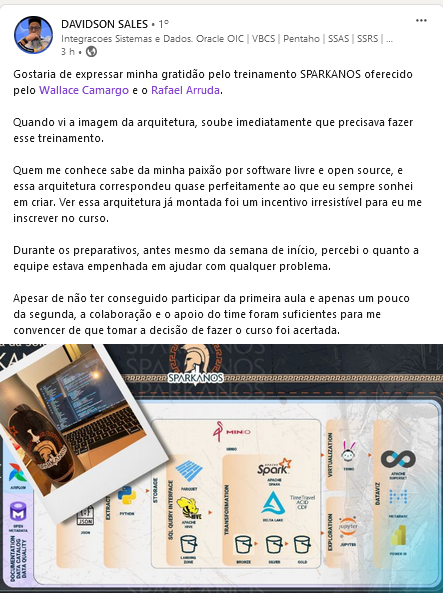

Desenho da solução do Curso

O projeto Sparkanos visa em ensinar a construir e

operar uma plataforma de dados completa seguindo as

melhores práticas de mercado.

O que o aluno irá aprender?

– Documentar projetos de forma profissional com padrões de mercado

– Entendimento prático sobre CI/CD e sua importância

– Construção de um framework com funções reutilizáveis

– Implementação de verificação de qualidade de dados

Ferramentas Utilizadas:

– Docker: Criação e gerenciamento de containers

– Docker Swarm: Orquestração simplificada de containers

– Git + GitHub: Controle de versão e colaboração

– GitHub Actions: Configuração de pipelines de CI/CD

– Mkdocs: Geração de documentação clara e acessível

– Terraform + Google Cloud (opcional): Infraestrutura como código para ambientes em nuvem

– Apache Spark: Processamento de grandes volumes de dados de forma distribuída

– Apache Airflow: Orquestração e agendamento de pipelines com Apache Spark

– Open Metadata: Catálogo de metadados e governança de dados

– MinIO: Data Lake com suporte ao protocolo S3 da AWS

– Tabelas Delta: Formato de armazenamento para contrução do Lakehouse

– Trino: Engine de query para consultas SQL distribuídas

– Superset: Visualização e análise de dados, com suporte a segurança por linha (Row Level Security)

Use case do projeto:

– Integração entre todas as ferramentas

– Criação de um framework Apache Spark com carga full e incremental

– Criação de uma aplicação real time com Apache Spark

– Construção de Lakehouse com tabelas Delta e camadas bronze, silver e gold

– Orquestração do Apache Spark no Airflow

– Execução de consultas SQL no Lakehouse com o Trino

– Visualização do dados com aplicação de Row Level Security (RLS)

– Catalogação de todos os metadados

– Aplicação de testes e qualidade de dados

Vantagens:

– Possibilidade de criar uma POC (Prova de conceito) na sua empresa

– Ferramentas open source

Depoimentos

APRENDIZADO GARANTIDO

O Aluno que participar do treinamento e conseguir colocar em prática o conteúdo do treinamento estará preparado não só para diversos projetos na área quanto para começar a prestar a sua próprias consultorias, pois tem o que os clientes procuram: Conhecimento e também entregar valor para as empresas.

E claro, a nossa metodologia tão reconhecida pelos nossos alunos, 99% Hand-ons, onde iremos criar uma plataforma de dados juntos, etapa por etapa! São 16 horas de Treinamento com muito conteúdo compartilhado e também com um network com diversos profissionais da área de dados!

Aproveite essa incrível oportunidade em mais um lançamento da Arruda Consulting.

Sobre o Instutor

Wallace Camargo

MBA em Business Intelligence (BI) - Administrador, profissional com mais de 6 anos de experiência na área de dados, tendo trabalhado focado em análise no início e desde de 2022 totalmente dedicado à engenharia de dados.